Modération de contenu : définition, enjeux et bonnes pratiques

Entre commentaires haineux, spams publicitaires et contenus illicites, vos équipes croulent sous les interactions à risque. La modération de contenu n’est plus une option. C’est devenu un pilier stratégique pour protéger votre marque, sécuriser vos communautés et préserver votre e-réputation.

Mais face à l’explosion des volumes, à la multiplication des canaux et à l’essor de l’IA, une question revient sans cesse : entre modération humaine et automatisation, comment s’y retrouver sans perdre le contrôle ?

Si vous cherchez à comprendre les enjeux de la modération en ligne et à mettre en place des pratiques réellement efficaces pour 2026, vous êtes au bon endroit. Dans ce guide complet, on décortique tout ce qu’il faut savoir sur la modération de contenu, sans jargon inutile ni vision théorique déconnectée du terrain.

Sommaire

Qu’est-ce que la modération de contenu, concrètement ?Pourquoi la modération de contenu est-elle devenue indispensable pour les marques ?Quels sont les différents types de modération ?Quels contenus faut-il modérer en priorité ?Comment mettre en place une stratégie de modération efficace et scalable ?Quelles sont les erreurs de modération les plus courantes ?FAQ sur la modération de contenuEn bref

La modération de contenu consiste à détecter, filtrer et traiter les contenus inappropriés publiés sur vos espaces en ligne. Elle répond à plusieurs enjeux majeurs : protection de l’image de marque, conformité réglementaire, sécurité des utilisateurs et qualité de l’expérience communautaire.

En 2026, les approches hybrides, combinant modération automatique par IA et supervision humaine, s’imposent comme le standard le plus performant. Une stratégie de modération efficace repose sur des règles claires, des outils adaptés à vos volumes et une optimisation continue basée sur la donnée.

Qu’est-ce que la modération de contenu ?

La modération de contenu, ou content moderation, désigne l’ensemble des actions mises en place pour contrôler, filtrer et gérer les contenus publiés par les utilisateurs sur vos plateformes digitales.

Concrètement, il s’agit d’identifier et de traiter les messages toxiques, les images inappropriées, les vidéos violentes, les tentatives d’arnaque ou tout contenu qui enfreint vos règles de communauté. Cela concerne aussi bien les commentaires sur les réseaux sociaux que les avis clients, les chats en direct, les forums ou les fonctionnalités communautaires intégrées à une application.

Aujourd’hui, la modération de contenu ne se limite plus à supprimer des messages après signalement. Elle est devenue un système global de protection et de pilotage des interactions en ligne, au cœur des stratégies marketing, produit et Trust & Safety.

Une définition élargie de la modération de contenu

Réduire la modération à une simple suppression serait une erreur. Une approche moderne de la modération de contenu englobe plusieurs dimensions complémentaires.

La première est la détection. Il s’agit d’identifier automatiquement ou manuellement les contenus à risque parmi des milliers, voire des millions d’interactions quotidiennes. Sans cette capacité, toute modération devient réactive et donc trop lente.

Vient ensuite le filtrage. Certaines plateformes choisissent de bloquer en temps réel des contenus manifestement problématiques avant même leur publication. Cette modération préventive permet de limiter les débordements visibles et de réduire drastiquement les risques de crise.

La modération inclut également une dimension d’analyse. Comprendre quels types de contenus posent problème, à quels moments, sur quels canaux et auprès de quelles audiences permet d’anticiper les pics de toxicité et d’ajuster les règles. C’est là que les outils d’analyse et de compréhension prennent toute leur valeur.

Enfin, la réponse est un élément clé. Supprimer un contenu n’est qu’une option parmi d’autres. Selon le contexte, il peut s’agir d’un avertissement, d’un bannissement temporaire ou définitif, ou d’une escalade vers une équipe humaine.

Quel que soit votre environnement — page Facebook, communauté Discord, site e-commerce avec avis clients ou application mobile avec chat intégré — la modération de contenu s’applique à l’ensemble de vos espaces d’interaction.

Modération de contenu vs community management

La confusion entre modération de contenu et community management est fréquente, et pourtant, les deux rôles sont bien distincts.

Le community management vise à animer, engager et développer une communauté. Il s’agit de créer du lien, de produire du contenu positif, de répondre aux questions et de stimuler les échanges.

La modération de contenu, elle, joue un rôle de protection. Elle consiste à éliminer le négatif pour permettre au positif d’exister. Sans modération efficace, même la meilleure stratégie de community management finit par s’essouffler, noyée sous les comportements toxiques.

Les deux approches sont donc complémentaires, mais ne répondent pas aux mêmes objectifs opérationnels ni aux mêmes contraintes. En pratique, la modération est souvent le socle invisible sur lequel repose toute expérience communautaire saine.

Pourquoi la modération de contenu est-elle devenue indispensable ?

Si la modération de contenu est aujourd’hui au centre des préoccupations des marques, ce n’est pas par effet de mode. C’est la conséquence directe de trois transformations majeures : l’explosion des volumes, l’exposition permanente des marques et le durcissement du cadre réglementaire.

Autrement dit, ne pas modérer n’est plus un simple risque opérationnel. C’est un risque business, juridique et réputationnel.

Des volumes d’interactions devenus impossibles à gérer manuellement

Les espaces d’expression se sont multipliés. Réseaux sociaux, plateformes vidéo, chats en direct, forums, avis clients, messageries intégrées, lives. Chaque canal génère ses propres flux, ses codes, ses pics d’activité.

Aujourd’hui, une marque un peu visible peut recevoir en quelques heures plus de commentaires qu’elle n’en recevait en un mois il y a cinq ans. Lors d’un lancement de produit, d’une campagne ou d’un événement en direct, ces volumes peuvent exploser brutalement.

Dans ce contexte, la modération humaine seule atteint très vite ses limites. Même avec des équipes dédiées, il devient matériellement impossible de lire, analyser et traiter chaque message dans des délais acceptables.

C’est précisément ce qui explique la montée en puissance de la modération automatique, capable de traiter des millions d’interactions en temps réel. Mais à ce stade, il ne s’agit pas encore de choisir une approche. Il s’agit de reconnaître un fait simple : le volume a changé d’échelle.

Découvrez notre guide sur le choix entre modération automatique ou modération humaine

Une exposition permanente de la marque, même hors de ses propres contenus

Un point souvent sous-estimé : la marque n’est plus uniquement jugée sur ce qu’elle publie, mais sur ce qu’elle laisse visible.

Un commentaire raciste sous une publication Instagram, une menace sous une vidéo YouTube, une série d’insultes sur un live TikTok. Même si ces contenus ne viennent pas de la marque, ils lui sont immédiatement associés.

Aux yeux des utilisateurs, laisser faire équivaut souvent à cautionner. Et dans l’économie de l’attention actuelle, quelques minutes suffisent pour qu’un commentaire problématique soit capturé, partagé et amplifié.

C’est là que la modération de contenu devient un outil de protection de l’e-réputation, bien au-delà d’une simple logique de nettoyage (lien interne vers le cocon E-réputation). Une modération efficace réduit la visibilité des signaux négatifs avant qu’ils ne prennent de l’ampleur.

Ce point est clé dans la gestion des crises. Dans la majorité des bad buzz, le problème initial n’est pas le message déclencheur, mais le délai de réaction. La modération en temps réel permet d’intervenir avant que la conversation ne bascule.

La sécurité des utilisateurs comme condition de l’engagement

Une communauté n’est jamais neutre. Elle est soit accueillante, soit hostile. Et cette perception se construit très vite.

Lorsque les utilisateurs sont exposés à des propos haineux, du harcèlement ou des contenus violents, deux réactions se produisent presque systématiquement. Les profils toxiques s’installent durablement. Les profils légitimes, eux, partent.

Ce phénomène est documenté sur de nombreuses plateformes. Une modération défaillante crée un cercle vicieux : moins de qualité, donc moins d’engagement, donc plus de place laissée aux comportements problématiques.

À l’inverse, une modération cohérente et visible crée un climat de confiance. Les utilisateurs comprennent rapidement les règles implicites et adaptent leur comportement. La modération devient alors un levier indirect de performance communautaire.

Ce sujet est particulièrement critique pour les plateformes à forte interaction comme les médias, le gaming, les applications sociales ou les marques grand public exposées à des audiences très larges

Un cadre légal de plus en plus contraignant pour les marques

La modération de contenu n’est plus seulement une bonne pratique. Elle devient une obligation réglementaire.

En Europe, le Digital Services Act (DSA) impose aux plateformes et aux acteurs numériques des responsabilités accrues en matière de lutte contre les contenus illicites. Les délais de retrait, la transparence des règles, la traçabilité des décisions et la capacité à agir rapidement sont désormais encadrés.

Pour les marques qui gèrent des espaces communautaires, cela signifie une chose très concrète : l’inaction peut être sanctionnée. Amendes, injonctions, atteinte à la réputation. Le risque n’est plus théorique.

Cette évolution pousse de nombreuses entreprises à professionnaliser leur approche. La modération ne peut plus reposer sur des règles floues ou des décisions improvisées. Elle doit être structurée, documentée et mesurable.

C’est aussi ce qui explique l’adoption croissante de solutions de modération hybrides, combinant automatisation et supervision humaine, capables de répondre à la fois aux exigences de volume et aux contraintes réglementaires

Une attente forte de transparence et de cohérence

Enfin, les utilisateurs eux-mêmes ont changé. Ils attendent des marques qu’elles prennent position, qu’elles protègent leurs espaces et qu’elles appliquent leurs règles de manière cohérente.

Supprimer un commentaire sans explication, laisser passer un message similaire ailleurs, bannir sans recours possible. Toutes ces pratiques génèrent de la frustration et alimentent la défiance.

Une stratégie de modération efficace repose donc aussi sur la clarté des règles et la cohérence des décisions. Ce n’est pas seulement un enjeu technique, c’est un enjeu de confiance.

Quels sont les différents types de modération ?

Toutes les stratégies de modération ne se valent pas. Et surtout, elles ne répondent pas aux mêmes contraintes.

Selon vos volumes, vos canaux, votre exposition et vos objectifs, vous pouvez vous appuyer sur trois grandes approches : la modération humaine, la modération automatique et la modération hybride. Chacune a ses forces, ses limites et ses cas d’usage privilégiés.

Le vrai sujet n’est donc pas de savoir laquelle est “la meilleure” dans l’absolu, mais laquelle est adaptée à votre réalité opérationnelle.

La modération humaine : précision maximale, mais limites structurelles

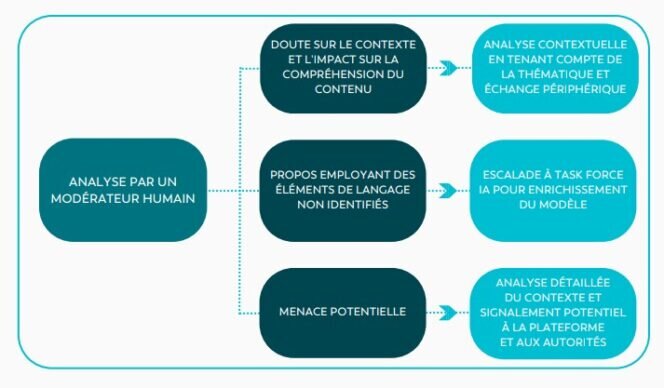

La modération humaine est l’approche historique. Des modérateurs analysent manuellement les contenus signalés ou publiés et prennent une décision en fonction du contexte, du ton et des règles établies.

Son principal avantage réside dans la compréhension fine des nuances. Ironie, second degré, références culturelles, détournements de langage. Là où une machine peut hésiter, l’humain comprend. C’est pour cette raison que la modération humaine reste indispensable pour les cas complexes, sensibles ou ambigus.

Elle est particulièrement pertinente dans les contextes suivants :

- gestion de situations à fort enjeu réputationnel,

- analyse de contenus limites ou contextuels,

- arbitrage lors de conflits ou de contestations.

Mais cette approche montre rapidement ses limites dès que les volumes augmentent. Lire, comprendre et traiter manuellement des centaines ou des milliers de messages par jour est coûteux, lent et difficilement scalable. Les délais de réaction s’allongent, ce qui laisse le temps aux contenus problématiques de circuler.

Autre point souvent sous-estimé : l’impact humain. L’exposition répétée à des contenus violents, haineux ou traumatisants peut entraîner une fatigue émotionnelle importante, voire un burnout des modérateurs.

C’est pour ces raisons que la modération humaine ne peut plus être envisagée comme une solution unique, mais comme un maillon d’un dispositif plus large

La modération automatique : vitesse et volume, mais dépendante de la qualité de l’IA

La modération automatique repose sur l’intelligence artificielle pour analyser, classer et filtrer les contenus en temps réel, sans intervention humaine directe.

Son principal atout est évident : la vitesse. Une solution de modération automatique peut traiter des millions de messages par jour, en quelques millisecondes. Elle est donc parfaitement adaptée aux plateformes à fort trafic, aux lives, aux commentaires ouverts ou aux applications communautaires à grande échelle.

Elle permet notamment :

- de bloquer instantanément les insultes, menaces et spams évidents,

- de réduire drastiquement le bruit toxique visible,

- de soulager les équipes humaines des tâches répétitives.

Cependant, toutes les modérations automatiques ne se valent pas. Les systèmes basés uniquement sur des listes de mots-clés montrent aujourd’hui leurs limites. Fautes volontaires, emojis, détournements, leetspeak. Les utilisateurs ont appris à contourner ces filtres depuis longtemps.

C’est là qu’interviennent les modèles de langage avancés, capables d’analyser le sens, le contexte et l’intention derrière un message. Ces approches permettent une modération beaucoup plus fine, notamment sur des sujets sensibles comme le harcèlement voilé ou les discours haineux indirects.

Malgré ces avancées, la modération automatique reste imparfaite sur les zones grises. Sans supervision humaine, elle peut générer des faux positifs ou passer à côté de certaines subtilités.

La modération hybride : l’approche la plus efficace en 2026

C’est ici que les deux mondes se rejoignent.

La modération hybride combine la puissance de l’automatisation et la finesse du jugement humain. En pratique, l’IA traite la grande majorité des contenus évidents, tandis que les cas ambigus sont escaladés vers des modérateurs humains.

Dans la majorité des configurations efficaces, l’intelligence artificielle filtre automatiquement entre 90 et 95 % des contenus problématiques clairs. Les 5 à 10 % restants, plus complexes ou contextuels, sont analysés manuellement.

Cette approche présente plusieurs avantages décisifs :

- réduction massive des délais de réaction,

- diminution de la charge mentale des équipes,

- amélioration continue grâce aux retours humains,

- cohérence des décisions dans le temps.

C’est aujourd’hui le standard adopté par les plateformes les plus exposées et par les marques qui souhaitent à la fois protéger leur image et offrir une expérience saine à leurs communautés.

Chez Bodyguard, cette logique hybride est au cœur de la solution, avec une IA entraînée sur des contextes réels et une supervision humaine spécialisée

Solution de modération hybride Bodyguard

Quels contenus faut-il modérer en priorité ?

Toutes les interactions ne présentent pas le même niveau de risque. Et toutes ne doivent pas être traitées avec la même urgence.

Une stratégie de modération efficace ne cherche pas à tout contrôler de manière uniforme. Elle hiérarchise. Elle identifie les contenus à fort impact négatif potentiel et concentre ses efforts là où le danger est réel, pour les utilisateurs comme pour la marque.

Voici les grandes catégories de contenus à surveiller en priorité en 2026.

Les contenus haineux et discriminatoires

C’est la priorité absolue.

Racisme, sexisme, homophobie, transphobie, discours xénophobes ou religieux. Ces contenus violent les règles de toutes les plateformes, mais surtout, ils exposent directement votre marque à un risque réputationnel majeur.

Un seul commentaire haineux laissé visible trop longtemps peut :

- encourager un effet boule de neige dans les réponses,

- transformer un espace d’échange en zone toxique,

- déclencher un bad buzz ou une crise médiatique.

Le défi principal n’est plus la détection des insultes évidentes, mais celle des formes détournées. Codes, emojis, fautes volontaires, références culturelles ou mèmes sont aujourd’hui utilisés pour contourner les filtres basiques.

C’est pour cette raison qu’une modération multilingue et contextuelle est indispensable, notamment si vous opérez à l’international (français, anglais, arabe, espagnol, chinois, etc.).

Le harcèlement et les menaces

Le harcèlement en ligne ne se limite pas aux insultes frontales. Il peut être progressif, coordonné et insidieux.

Attaques répétées contre une même personne, moqueries ciblées, insinuations, menaces voilées, divulgation d’informations personnelles. Ces comportements créent un climat de peur et poussent les utilisateurs légitimes à quitter vos espaces.

Le vrai défi ici est l’analyse comportementale. Pris individuellement, certains messages peuvent sembler anodins. Pris dans leur ensemble, ils révèlent une stratégie de harcèlement.

Une modération efficace doit donc être capable de :

- identifier des patterns d’attaque,

- détecter les raids ou attaques coordonnées,

- comprendre la dynamique entre plusieurs comptes.

Ce type de modération dépasse largement la simple analyse de mots-clés. Il nécessite une vision globale des interactions et une capacité à relier les signaux faibles.

Les contenus sexuels et violents

Nudité non sollicitée, pornographie, violence graphique, automutilation, contenus choquants. Ces publications nuisent gravement à l’expérience utilisateur et peuvent être particulièrement traumatisantes pour les publics sensibles ou mineurs.

Sur les réseaux sociaux, ces contenus peuvent entraîner :

- une baisse brutale de l’engagement,

- des sanctions de la plateforme,

- une perte de crédibilité pour la marque.

La difficulté est que ces contenus ne sont pas toujours textuels. Les images, vidéos et GIFs sont aujourd’hui massivement utilisés pour contourner les règles.

La modération d'images devient donc un pilier stratégique. L’analyse d’images et de vidéos par IA permet désormais de détecter automatiquement :

- la nudité,

- les scènes de violence,

- certains gestes ou signaux à risque.

Le spam et les arnaques

Le spam est souvent sous-estimé car il semble moins “grave” que la haine ou la violence. Pourtant, son impact est considérable.

Faux concours, liens frauduleux, promotions déguisées, usurpation d’identité de marque. Ces contenus polluent les discussions, nuisent à la confiance et peuvent exposer vos utilisateurs à de véritables arnaques.

Certaines attaques vont plus loin en se faisant passer pour votre entreprise afin de tromper votre audience. Dans ce cas, c’est directement votre crédibilité qui est en jeu.

Une bonne modération du spam repose sur deux piliers :

- la détection de patterns répétitifs,

- l’analyse comportementale des comptes (ancienneté, fréquence, liens externes).

Comment mettre en place une stratégie de modération efficace ?

Comprendre la modération de contenu, c’est une chose. La mettre en place correctement, à grande échelle, en est une autre.

Une stratégie de modération efficace ne repose pas sur un outil isolé ou sur des décisions prises au cas par cas. Elle repose sur une combinaison claire de règles, de technologie, de process humains et de pilotage par la donnée.

Voici les fondations indispensables pour construire une modération solide, durable et réellement opérationnelle en 2026.

Définir des règles de communauté claires et actionnables

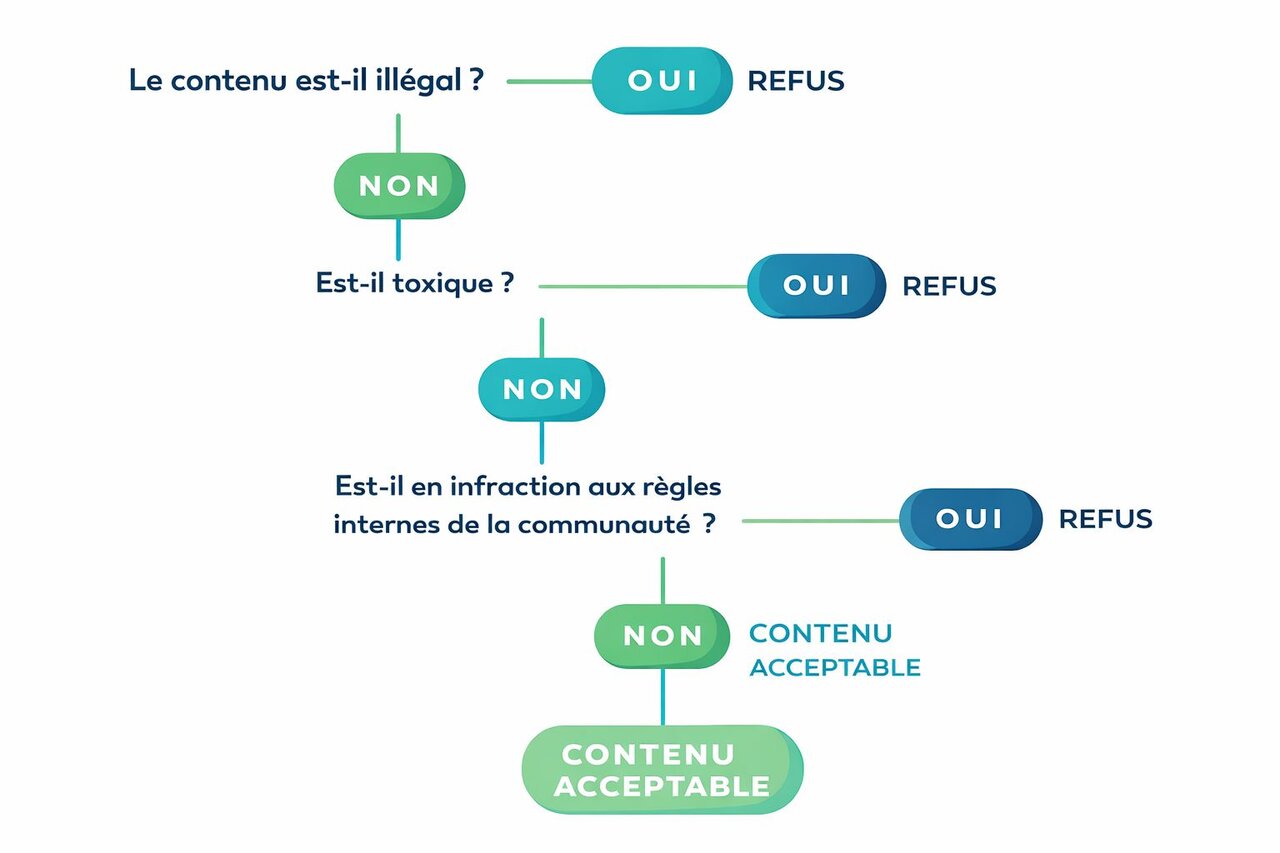

Avant de modérer, il faut décider ce qui est acceptable et ce qui ne l’est pas.

Des règles floues ou implicites conduisent à des décisions incohérentes, des frustrations côté utilisateurs et une perte de crédibilité. À l’inverse, des guidelines claires facilitent la prise de décision, aussi bien pour l’IA que pour les équipes humaines.

Ces règles doivent répondre à des questions très concrètes :

- quels types de contenus sont strictement interdits,

- quels contenus sont tolérés sous conditions,

- quels cas nécessitent une escalade humaine,

- quelles sanctions sont appliquées selon la gravité.

Par exemple, adoptez-vous une tolérance zéro sur les insultes, ou acceptez-vous certains jurons légers selon le contexte ? Les débats politiques sont-ils autorisés sur vos espaces ? Quid de l’humour noir ou de la satire ?

Plus ces règles sont précises, plus votre modération sera cohérente dans le temps.

Adapter la modération à chaque canal et à chaque audience

Tous les canaux ne se modèrent pas de la même manière.

Les attentes sur LinkedIn, TikTok, Instagram, YouTube ou Discord sont radicalement différentes. Le ton, les formats et les comportements varient selon la plateforme et selon la cible.

Une page LinkedIn B2B nécessite des règles plus strictes qu’un compte TikTok grand public. Un forum communautaire n’a pas les mêmes exigences qu’un chat in-game.

Une stratégie efficace adapte donc :

- les seuils de tolérance,

- les règles,

- les priorités de modération,

- les temps de réaction,

C’est aussi pour cette raison qu’une modération centralisée multi-plateformes est devenue indispensable pour garder une vision cohérente sans multiplier les outils.

Choisir les bons outils de modération

La technologie est un levier, pas une solution magique.

En 2026, trois grandes catégories d’outils coexistent :

Les outils natifs des plateformes offrent des filtres basiques et des systèmes de signalement. Ils sont gratuits mais très limités. Ils fonctionnent en silo et ne permettent pas une vision globale.

Les solutions SaaS spécialisées proposent une modération centralisée, multi-canaux, avec de l’IA contextuelle et des tableaux de bord analytiques. Elles sont adaptées aux marques exposées et aux plateformes à fort trafic.

Les API de modération permettent une intégration directe dans les produits tech, applications mobiles ou plateformes communautaires, avec un filtrage en amont de la publication.

Le bon choix dépend de vos volumes, de votre maturité technique et de vos contraintes business. Mais une chose est certaine : se reposer uniquement sur des listes de mots-clés n’est plus suffisant.

Solution de modération hybride Bodyguard

Modération de contenu : les erreurs à éviter absolument

Même avec de bonnes intentions, beaucoup de stratégies de modération échouent. Non pas par manque d’outils, mais à cause de décisions mal calibrées, souvent prises trop tard.

Voici les erreurs les plus fréquentes en 2026, et pourquoi elles coûtent cher en image, en engagement et parfois en conformité légale.

Se contenter d’une modération a posteriori

C’est l’erreur la plus répandue.

Attendre qu’un contenu soit publié, signalé par les utilisateurs, puis supprimé, revient à intervenir quand le mal est déjà fait. Le commentaire a été vu, capturé en screenshot, partagé ailleurs.

En matière de réputation, quelques minutes suffisent pour perdre le contrôle.

Une stratégie moderne privilégie :

- la modération préventive, avant publication quand c’est possible,

- ou la modération en temps réel, avec des délais de réaction de quelques secondes.

Cela permet d’éviter l’effet boule de neige et de contenir les débordements avant qu’ils ne prennent de l’ampleur.

Ignorer le contexte linguistique et culturel

Un mot peut être inoffensif dans une langue et profondément insultant dans une autre. Une expression peut être humoristique dans un pays et choquante ailleurs.

Appliquer les mêmes règles à toutes les langues est une erreur classique, surtout pour les marques internationales.

Une modération efficace doit :

- comprendre les nuances culturelles,

- s’adapter aux usages locaux,

- intégrer des modèles multilingues réellement entraînés.

Modérer de l’arabe, de l’espagnol ou du chinois avec des règles pensées uniquement pour le français ou l’anglais mène inévitablement à des erreurs.

Conclusion : la modération de contenu, un investissement stratégique en 2026

La modération de contenu n’est plus une simple tâche opérationnelle. En 2026, c’est un levier stratégique qui touche à tout ce qui fait la valeur d’une marque en ligne.

Elle protège votre image quand les volumes explosent.

Elle sécurise vos communautés quand les usages se durcissent.

Elle garantit la conformité quand les cadres légaux se renforcent.

Et surtout, elle conditionne l’expérience vécue par vos utilisateurs.

Les marques qui réussissent aujourd’hui ont compris une chose essentielle : laisser la toxicité s’installer coûte toujours plus cher que de la prévenir. En réputation, en engagement, en churn, parfois même en sanctions juridiques.

Ce guide l’a montré étape par étape :

- comprendre ce qu’est réellement la modération de contenu,

- identifier les contenus à risque prioritaires,

- choisir entre modération humaine, automatique ou hybride,

- mettre en place des règles claires, des outils adaptés et des process solides,

- éviter les erreurs classiques qui sabotent les stratégies les mieux intentionnées.

La tendance est claire.

À mesure que les formats se multiplient (vidéo, live, audio), que les langues se croisent et que les contenus générés par IA explosent, la modération devient un enjeu de gouvernance digitale.

C’est précisément pour répondre à ces enjeux que des solutions hybrides se sont imposées.

Chez Bodyguard, nous accompagnons des marques, des médias, des plateformes et des applications qui ont un point commun : elles ne peuvent pas se permettre de perdre le contrôle de leurs espaces en ligne. Notre approche combine intelligence artificielle avancée et supervision humaine pour offrir une modération en temps réel, précise et scalable.

FAQ sur la modération de contenu

La modération de contenu est-elle obligatoire légalement ?

Oui, de plus en plus.

En Europe, le Digital Services Act (DSA) impose aux plateformes et aux marques de mettre en place des dispositifs actifs de modération des contenus illicites. En France, les lois contre les contenus haineux renforcent également ces obligations.

Ne pas modérer expose à des sanctions financières, juridiques et réputationnelles.

Comment éviter les faux positifs en modération automatique ?

Les faux positifs surviennent lorsque des contenus légitimes sont supprimés à tort.

Pour les limiter :

- évitez les simples listes de mots-clés,

- privilégiez des solutions basées sur des LLMs capables de comprendre le contexte,

- configurez des seuils de confiance adaptés,

- escaladez les cas ambigus vers des modérateurs humains,

- analysez régulièrement les décisions pour ajuster les règles.

Peut-on modérer efficacement sans censurer la liberté d’expression ?

Oui.

La modération ne vise pas à supprimer toute critique ou désaccord. Elle sert à éliminer les contenus qui empêchent les échanges sains d’exister.

Une modération bien pensée protège la liberté d’expression en supprimant la toxicité, pas le débat. La transparence des règles et la possibilité de contestation sont essentielles pour maintenir cet équilibre.

Quels sont les principaux défis de la modération de contenu en 2026 ?

Les défis majeurs sont :

- l’essor des contenus générés par IA et des deepfakes,

- la sophistication des techniques de contournement des filtres,

- la multiplication des langues et dialectes,

- la modération en temps réel des lives et formats courts,

- la protection de la santé mentale des modérateurs.

Ces évolutions rendent indispensable une approche technologique avancée, couplée à une supervision humaine structurée.

Vous voulez découvrir Bodyguard ?

Demander une démo

© 2025 Bodyguard.ai — Tous droits réservés.