Comment modérer Facebook, Instagram, TikTok et YouTube efficacement en 2026

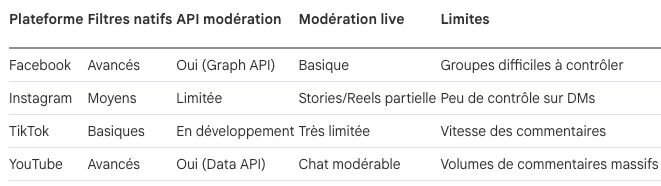

Chaque réseau social possède son propre ADN : son format de contenu, son algorithme, son audience et ses formes de toxicité. Modérer un commentaire haineux sous une vidéo YouTube n'a rien à voir avec la gestion d'un message toxique dans un live TikTok ou la modération d'un thread Facebook. Pourtant, de nombreuses marques appliquent encore la même stratégie de modération sur toutes leurs plateformes, avec des résultats décevants.

Chez Bodyguard.ai, nous protégeons des communautés sur l'ensemble des grands réseaux sociaux, de Facebook à TikTok en passant par Instagram et YouTube. Notre expérience nous a montré que l'efficacité d'une modération réseaux sociaux dépend avant tout de sa capacité à s'adapter aux spécificités de chaque plateforme.

Dans ce guide, nous décryptons les défis uniques de la modération Facebook, de la modération Instagram, de la modération TikTok et de la modération YouTube. Pour chaque réseau, vous découvrirez les types de contenus toxiques les plus fréquents, les outils natifs disponibles et les stratégies avancées pour protéger votre communauté. Pour une vision globale de la modération, consultez notre guide complet sur la modération de contenu.

Sommaire

Pourquoi chaque réseau social nécessite-t-il une stratégie de modération spécifique ?Comment modérer Facebook efficacement ?Comment modérer Instagram efficacement ?Comment modérer TikTok efficacement ?Comment modérer YouTube efficacement ?Comment unifier sa stratégie de modération sur tous les réseaux sociaux ?

Comment modérer Facebook efficacement ?

Les défis spécifiques de la modération Facebook

Facebook reste le réseau social le plus vaste avec près de 3 milliards d'utilisateurs actifs mensuels. Cette échelle massive génère un volume de contenu colossal à modérer. La modération Facebook doit relever plusieurs défis majeurs :

Les groupes Facebook constituent des espaces semi-privés où la toxicité peut proliférer à l'abri des regards. Les administrateurs de groupes disposent d'outils limités et sont souvent débordés par le volume de contenus.

Les commentaires sous articles partagés deviennent fréquemment des terrains de confrontation, particulièrement sur les sujets politiques et sociétaux. Le partage d'articles de désinformation amplifie ces tensions.

Facebook Messenger et les conversations privées représentent un angle mort majeur, où le cyberharcèlement peut se développer sans surveillance.

Le Marketplace génère des interactions transactionnelles qui attirent arnaques, spams et comportements malveillants nécessitant une modération spécifique.

Stratégies avancées pour la modération Facebook

Automatisation intelligente des commentaires : Configurez des filtres avancés qui vont au-delà des simples mots-clés. Notre solution analyse le contexte des commentaires Facebook en temps réel, détectant les attaques voilées et le harcèlement subtil que les filtres natifs manquent. Pour comprendre cette approche, consultez notre article sur l'importance du contexte en modération.

Modération proactive des groupes : Mettez en place des règles claires, des modérateurs actifs et des outils de détection automatique. Les groupes nécessitent une surveillance continue, particulièrement lors de sujets sensibles ou d'actualité brûlante.

Gestion des pages de marque : Les commentaires sur vos pages Facebook impactent directement votre image. Une modération Facebook efficace protège votre e-réputation en filtrant la toxicité tout en préservant les critiques constructives.

Surveillance des partages et mentions : Au-delà de vos propres espaces, surveillez comment votre marque est mentionnée sur Facebook pour anticiper les crises potentielles.

KPIs essentiels pour la modération Facebook

- Temps de réponse moyen sur les commentaires toxiques

- Taux de détection dans les groupes vs pages publiques

- Volume de contenus modérés par jour

- Taux de récidive des utilisateurs sanctionnés

- Impact sur le taux d'engagement positif

Solution de modération Facebook

Comment modérer Instagram efficacement ?

Les défis spécifiques de la modération Instagram

Instagram est le royaume du visuel, et la modération Instagram doit jongler entre formats multiples : posts classiques, stories éphémères, reels viraux et lives interactifs. Chaque format génère ses propres formes de toxicité.

Les commentaires sous posts sont le terrain classique de la toxicité sur Instagram. Les comptes à forte audience (influenceurs, marques) reçoivent des volumes massifs de commentaires, rendant la modération manuelle impossible.

Les DMs et messages privés sont le vecteur principal du cyberharcèlement sur Instagram, particulièrement envers les créateurs de contenu et les jeunes utilisateurs. La modération de ces espaces reste un défi majeur.

Les stories et reels génèrent des interactions rapides et éphémères. Les mentions, les réponses aux stories et les commentaires sur les reels nécessitent une modération en quasi-temps réel.

Le contenu visuel ajoute une couche de complexité : images retouchées, texte incrusté dans les images et symboles visuels toxiques échappent souvent aux filtres textuels classiques.

Stratégies avancées pour la modération Instagram

Filtrage multicouche des commentaires : Combinez les filtres natifs d'Instagram (mots masqués, filtres automatiques) avec notre solution d'analyse contextuelle. Cette approche multicouche permet de capter la toxicité que les outils natifs laissent passer, notamment le harcèlement déguisé en compliments toxiques ou les sous-entendus culturels.

Surveillance des reels et stories : Les formats éphémères attirent des comportements impulsifs et des commentaires plus agressifs. Notre technologie de modération Instagram analyse les flux de commentaires en temps réel, même sur les contenus à durée limitée.

Protection des créateurs de contenu : Les influenceurs et créateurs sont des cibles privilégiées de cyberharcèlement. Mettez en place une modération renforcée sur leurs publications les plus exposées, avec des seuils de détection adaptés à leur audience.

Analyse visuelle complémentaire : La modération Instagram ne peut pas se limiter au texte. L'analyse des images et vidéos pour détecter les contenus inappropriés, les symboles haineux ou les montages malveillants est devenue indispensable.

Gestion proactive des hashtags : Certains hashtags attirent naturellement des contenus toxiques. Surveillez et modérez les espaces liés à vos hashtags de marque pour maintenir un environnement sain.

KPIs essentiels pour la modération Instagram

- Volume de commentaires toxiques filtrés par format (posts, reels, stories)

- Temps de détection sur les contenus éphémères

- Taux de protection des créateurs partenaires

- Ratio commentaires positifs/négatifs après modération

- Taux de faux positifs sur les commentaires ambigus

Solution de modération Instagram

Comment modérer TikTok efficacement ?

Les défis spécifiques de la modération TikTok

TikTok est la plateforme la plus dynamique et la plus imprévisible en matière de modération. La modération TikTok fait face à des défis uniques liés à la vitesse, au format vidéo et à la jeunesse de son audience.

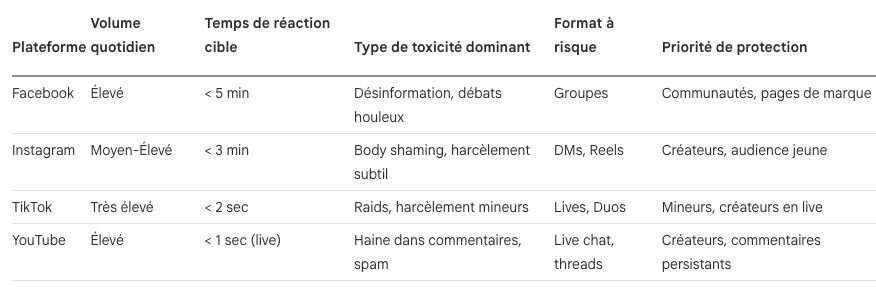

La viralité ultra-rapide est le défi numéro un. Un contenu peut passer de zéro à des millions de vues en quelques heures. Les commentaires explosent en volume, rendant toute modération manuelle impossible. La fenêtre d'intervention est extrêmement courte.

Les lives TikTok représentent un terrain particulièrement sensible. Les interactions se produisent en temps réel, et la toxicité peut surgir instantanément dans le chat. Les créateurs sont exposés en direct aux insultes, raids et comportements malveillants.

L'audience jeune de TikTok (une majorité d'utilisateurs a entre 16 et 24 ans) amplifie la responsabilité de modération. La protection des mineurs est un enjeu critique, notamment face au cyberharcèlement entre adolescents, au contenu inapproprié et aux prédateurs.

Les tendances et challenges peuvent rapidement dériver vers des contenus dangereux ou toxiques. Les duos et stitchs permettent de détourner des contenus originaux à des fins malveillantes.

Le code-switching linguistique est particulièrement fréquent sur TikTok, où les utilisateurs mélangent langues, argot et références culturelles dans des formats très courts, un défi que nous détaillons dans notre article sur la modération multilingue.

Stratégies avancées pour la modération TikTok

Modération en temps réel des lives : Le live est le format le plus à risque sur TikTok. Notre technologie analyse les flux de commentaires en direct, alertant les modérateurs ou filtrant automatiquement les messages toxiques avant qu'ils ne soient vus par le créateur et son audience.

Surveillance des tendances émergentes : Utilisez des outils de social listening pour identifier les challenges et tendances potentiellement dangereuses dès leur émergence, avant qu'elles ne deviennent virales.

Modération contextuelle des commentaires courts : Sur TikTok, les commentaires sont souvent très courts (quelques mots, emojis). La modération TikTok nécessite une compréhension contextuelle poussée pour interpréter correctement ces messages minimalistes. Notre IA excelle dans cette analyse grâce à son approche contextuelle.

Protection renforcée des mineurs : Implémentez des niveaux de modération plus stricts pour les comptes identifiés comme mineurs. La toxicité dirigée vers les jeunes utilisateurs doit être traitée avec une tolérance zéro.

Détection des raids et attaques coordonnées : TikTok est particulièrement vulnérable aux raids, où des groupes d'utilisateurs ciblent un créateur avec des vagues de commentaires toxiques. Notre analyse de patterns comportementaux détecte ces attaques coordonnées en temps réel.

KPIs essentiels pour la modération TikTok

- Temps de réaction sur les lives (objectif : < 2 secondes)

- Volume de commentaires toxiques filtrés lors de pics de viralité

- Taux de protection des comptes mineurs

- Nombre de raids détectés et neutralisés

- Vitesse de détection des tendances dangereuses

Solution de modération Tiktok

Comment modérer YouTube efficacement ?

Les défis spécifiques de la modération YouTube

YouTube est un écosystème unique où cohabitent vidéos longues, shorts, lives et une section commentaires parmi les plus actives du web. La modération YouTube doit gérer un volume colossal d'interactions avec une complexité sans équivalent.

La section commentaires massive : Une vidéo populaire peut générer des dizaines de milliers de commentaires. Ces espaces deviennent rapidement des arènes de débat où la toxicité prospère, particulièrement sous les contenus politiques, sociétaux ou polémiques.

Les live chats des streams YouTube sont des flux continus de messages à très haute vélocité. Modérer un chat avec des milliers de messages par minute nécessite une automatisation robuste et ultra-rapide.

Le contenu long format ajoute une difficulté temporelle : les commentaires continuent d'affluer des semaines, des mois, voire des années après la publication d'une vidéo. La modération YouTube doit donc être persistante dans le temps, contrairement aux formats éphémères de TikTok ou Instagram.

Les YouTube Shorts ont créé un nouveau terrain de toxicité, attirant une audience plus jeune et des comportements similaires à ceux observés sur TikTok, mais avec les outils de modération propres à YouTube.

Les réponses et threads de commentaires génèrent des conversations en chaîne où le contexte initial se perd rapidement, rendant l'analyse contextuelle encore plus cruciale.

Stratégies avancées pour la modération YouTube

Modération continue et persistante : Contrairement aux autres plateformes, la modération YouTube ne s'arrête jamais. Configurez une surveillance automatisée permanente de vos vidéos, même celles publiées il y a des mois. Un contenu ancien peut redevenir viral à tout moment et attirer une nouvelle vague de commentaires toxiques.

Gestion intelligente du live chat : Le live chat YouTube est un défi de vélocité. Notre technologie filtre les messages toxiques en temps réel, maintenant un environnement sain pour le créateur et sa communauté sans ralentir le flux de conversation.

Analyse des threads et contexte conversationnel : Les discussions YouTube peuvent s'étendre sur des dizaines de réponses imbriquées. Notre approche de compréhension contextuelle analyse l'ensemble du thread pour détecter le harcèlement progressif ou les escalades de conflit.

Segmentation par type de contenu : Adaptez vos règles de modération selon le type de vidéo. Un tutoriel éducatif ne génère pas la même toxicité qu'une vidéo d'opinion politique. Personnalisez les seuils de détection en conséquence.

Collaboration avec les créateurs : Impliquez les créateurs YouTube dans la stratégie de modération. Fournissez-leur des dashboards clairs et des outils leur permettant de comprendre et d'ajuster la modération de leur chaîne.

Surveillance des Shorts : Les YouTube Shorts attirent une audience et des comportements différents des vidéos classiques. Traitez ce format comme un canal distinct nécessitant sa propre stratégie de modération YouTube.

KPIs essentiels pour la modération YouTube

- Volume de commentaires modérés par vidéo

- Temps de modération sur le live chat (objectif : < 1 seconde)

- Couverture de modération sur les vidéos anciennes

- Taux de toxicité par catégorie de contenu

- Satisfaction des créateurs partenaires

- Ratio engagement positif avant/après modération

Solution de modération YouTube

Comment unifier sa stratégie de modération sur tous les réseaux sociaux ?

Définir une politique de modération globale et cohérente

La première étape d'une modération réseaux sociaux efficace est d'établir une politique de modération unifiée qui s'adapte ensuite aux spécificités de chaque plateforme. Cette politique doit définir :

- Les catégories de toxicité universelles : Harcèlement, discours haineux, spam, désinformation, contenus inappropriés

- Les seuils de tolérance par plateforme : Plus stricts sur TikTok (audience jeune), plus nuancés sur Facebook (débats communautaires)

- Les processus d'escalade : Quand un contenu détecté sur un réseau doit déclencher une surveillance renforcée sur tous les autres

- Le ton et l'approche : Comment votre marque communique ses décisions de modération à sa communauté

Cette politique globale est votre socle. Elle garantit la cohérence de votre image de marque tout en permettant la flexibilité nécessaire à chaque plateforme, un élément clé de la protection de votre e-réputation.

Centraliser la modération avec une solution multiplateforme

Gérer la modération Facebook, la modération Instagram, la modération TikTok et la modération YouTube avec des outils séparés est inefficace et coûteux. La centralisation via une solution unique offre des avantages décisifs :

- Vision unifiée : Un seul dashboard pour surveiller la toxicité sur tous vos réseaux. Notre interface centralise les données de modération Facebook, modération Instagram, modération TikTok et modération YouTube pour une vue à 360°.

- Cohérence des décisions : Les mêmes critères d'analyse contextuelle sont appliqués partout, adaptés aux spécificités de chaque plateforme.

- Économie de ressources : Une seule équipe, un seul outil, une seule formation. Vos modérateurs gagnent en efficacité en passant d'un réseau à l'autre sans changer d'environnement.

- Détection cross-plateforme : Un utilisateur toxique sur TikTok peut sévir simultanément sur Instagram. La centralisation permet d'identifier ces patterns multi-réseaux.

Adapter les seuils et règles par plateforme

Une stratégie unifiée ne signifie pas une stratégie identique partout. Chaque réseau nécessite des ajustements fins :

Facebook : Seuils plus nuancés pour préserver le débat dans les groupes, vigilance accrue sur la désinformation et les partages d'articles trompeurs. La modération Facebook doit distinguer l'expression d'opinion vive de la vraie toxicité.

Instagram : Attention renforcée sur la toxicité visuelle, le body shaming et le cyberharcèlement par DM. La modération Instagram doit être particulièrement sensible aux formes subtiles de harcèlement déguisé en commentaires apparemment positifs.

TikTok : Réactivité maximale et tolérance zéro pour la toxicité visant les mineurs. La modération TikTok privilégie la vitesse et la protection des audiences jeunes, avec des seuils plus stricts sur les insultes et le harcèlement.

YouTube : Modération persistante dans le temps et gestion des volumes massifs de commentaires. La modération YouTube nécessite une attention particulière aux threads longs et aux live chats à haute vélocité.

Exploiter le social listening cross-plateforme

Une crise ne se limite jamais à un seul réseau social. Un bad buzz sur Twitter peut se propager sur TikTok, être relayé sur Instagram et commenté sur YouTube en quelques heures. Le social listening cross-plateforme vous permet de :

- Détecter les signaux faibles de crise sur un réseau avant qu'ils ne se propagent

- Suivre la propagation d'un sujet sensible d'une plateforme à l'autre

- Coordonner votre réponse de gestion de crise sur tous les réseaux simultanément

- Mesurer l'impact de vos actions de modération globalement

Automatisation intelligente et supervision humaine

La clé d'une modération réseaux sociaux réussie en 2026 est l'équilibre entre IA et humain. Notre approche chez Bodyguard.ai fonctionne sur trois niveaux :

Niveau 1 — IA en première ligne : Notre technologie filtre automatiquement 90% des contenus toxiques sur Facebook, Instagram, TikTok et YouTube en temps réel. Les contenus clairement toxiques sont traités instantanément sans intervention humaine.

Niveau 2 — Zone grise : Les contenus ambigus détectés par l'IA sont signalés aux modérateurs humains pour une décision nuancée. C'est dans cette zone que l'analyse contextuelle et l'expertise humaine font la différence.

Niveau 3 — Supervision stratégique : Les équipes analysent les tendances globales, ajustent les paramètres de modération et anticipent les évolutions de la toxicité sur chaque plateforme. Cette vision macro est essentielle pour rester en avance sur les nouvelles formes de harcèlement.

Cette approche hybride, détaillée dans notre article modération automatique vs modération humaine, garantit à la fois réactivité et précision.

Mesurer et optimiser en continu

Une stratégie de modération réseaux sociaux efficace repose sur des données concrètes. Mettez en place un suivi rigoureux avec des métriques comparatives par plateforme :

Conclusion

Modérer efficacement Facebook, Instagram, TikTok et YouTube en 2026 exige bien plus qu'une approche uniforme. Chaque réseau social est un écosystème unique avec ses formats, ses audiences, ses formes de toxicité et ses outils. La modération Facebook doit gérer les groupes et la désinformation. La modération Instagram doit protéger contre le harcèlement visuel et les DMs toxiques. La modération TikTok doit être ultra-réactive pour protéger une audience jeune sur des lives imprévisibles. La modération YouTube doit être persistante et capable de gérer des volumes massifs sur la durée.

Pourtant, ces différences ne doivent pas conduire à une fragmentation de votre stratégie. La clé réside dans l'équilibre : une politique de modération globale et cohérente, déclinée avec intelligence sur chaque plateforme. Cette approche centralisée, combinant modération IA et expertise humaine, est la seule capable de protéger votre communauté à l'échelle et à la vitesse qu'exigent les réseaux sociaux modernes.

Chez Bodyguard.ai, nous accompagnons des marques, des plateformes et des créateurs dans cette mission quotidienne. Notre technologie d'analyse contextuelle s'adapte nativement aux spécificités de chaque réseau, garantissant une protection complète sans sacrifier la liberté d'expression légitime de vos communautés.

L'avenir de la modération réseaux sociaux s'annonce encore plus complexe avec l'émergence de nouveaux formats (réalité augmentée, espaces audio, métavers) et de nouvelles plateformes. Les marques qui investissent aujourd'hui dans une infrastructure de modération flexible et multiplateforme seront les mieux armées pour relever ces défis futurs.

Pour approfondir votre stratégie et découvrir comment protéger votre présence sur tous les réseaux sociaux, explorez notre guide complet sur la modération de contenu. Si vous souhaitez voir comment Bodyguard.ai peut sécuriser vos communautés sur Facebook, Instagram, TikTok et YouTube simultanément, [demandez une démonstration personnalisée].

*Cet article fait partie de notre série sur la modération de contenu. Découvrez également nos articles sur la modération IA et ses avantages, la modération multilingue et la keyword-based moderation et ses limites. Explorez aussi nos ressources sur la sécurité en ligne et la gestion de crise digitale pour une protection complète de votre écosystème digital.*

Vous voulez découvrir Bodyguard ?

Demander une démo

© 2025 Bodyguard.ai — Tous droits réservés.