Comment réagir à une attaque coordonnée de trolls

Il est 14h un mercredi. En l'espace de 10 minutes, 200 commentaires toxiques apparaissent sous votre dernière publication Instagram. Des comptes que vous n'avez jamais vus inondent vos espaces d'insultes, de fausses accusations et de memes haineux. Votre community manager est submergé. Les vrais clients qui commentaient ne sont plus visibles. Votre post ressemble à un champ de bataille.

Vous n'êtes pas face à des clients mécontents. Vous n'êtes pas face à un bad buzz organique. Vous êtes face à une attaque coordonnée de trolls — une action délibérée, planifiée et exécutée par un groupe organisé pour détruire votre espace de conversation et nuire à votre image.

En 2026, ces attaques sont devenues une réalité quotidienne pour les marques exposées. Elles sont planifiées sur Discord, Telegram ou 4chan, exécutées en quelques minutes et potentiellement dévastatrices si elles ne sont pas identifiées et neutralisées rapidement. Le plus pervers : elles imitent souvent un mécontentement organique pour brouiller les pistes et paralyser votre réponse.

Chez Bodyguard.ai, nous détectons et neutralisons ces attaques en temps réel pour nos clients. Notre technologie identifie les patterns de coordination — timing suspect, messages similaires, comptes récents — et les filtre avant qu'ils ne submergent vos espaces. Cette expérience nous a appris que la réponse à une attaque coordonnée est radicalement différente de la gestion d'une crise classique.

Dans cet article, nous vous donnons les protocoles concrets pour identifier, neutraliser et documenter une attaque coordonnée de trolls. Pour le cadre global de gestion de crise, consultez notre guide complet.

Sommaire

Qu'est-ce qu'une attaque coordonnée de trolls et comment la reconnaître ?Quels sont les différents types d'attaques coordonnées ?Comment réagir dans les premières minutes d'une attaque ?Comment neutraliser l'attaque sans alimenter les attaquants ?Comment documenter et signaler une attaque coordonnée ?Comment renforcer vos défenses pour prévenir les prochaines attaques ?Qu'est-ce qu'une attaque coordonnée de trolls et comment la reconnaître ?

Définition : ce qui distingue une attaque coordonnée d'un bad buzz organique

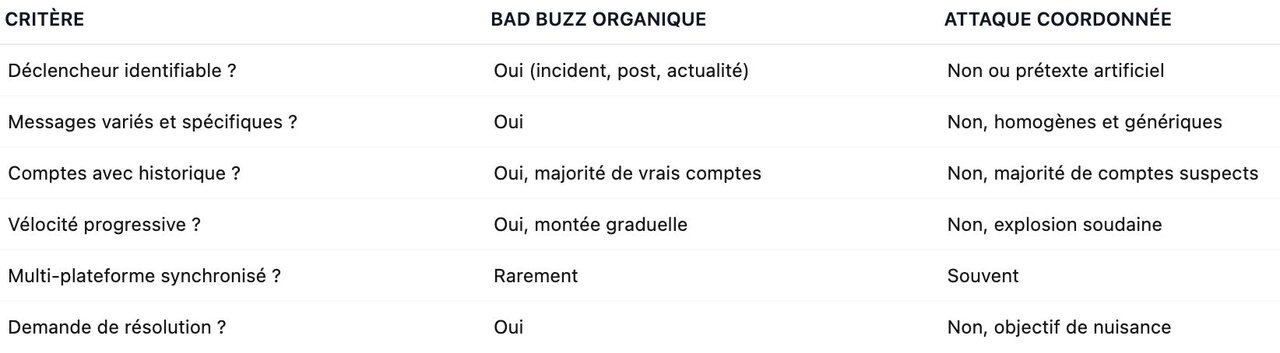

La distinction est fondamentale car la réponse est totalement différente :

Un bad buzz organique naît d'un mécontentement réel. Des vrais clients, avec de vrais problèmes, s'expriment spontanément. Leurs commentaires sont variés dans leur formulation, leurs griefs sont spécifiques et vérifiables, leurs comptes ont un historique authentique. La réponse appropriée est la transparence, l'empathie et l'action — comme nous le détaillons dans notre guide sur les 10 erreurs qui aggravent une crise.

Une attaque coordonnée est une action délibérée orchestrée par un groupe pour nuire. Les commentaires sont artificiels, les comptes sont souvent récents ou détournés, et l'objectif n'est pas d'obtenir une résolution mais de détruire.

Confondre les deux est dangereux dans les deux sens :

- Traiter un bad buzz organique comme une attaque → Vous ignorez de vrais problèmes et perdez la confiance de vrais clients

- Traiter une attaque coordonnée comme un bad buzz → Vous répondez à des trolls, ce qui les nourrit et amplifie leur impact

Les 7 signaux qui trahissent une attaque coordonnée

Signal 1 — La vélocité anormale

Un volume de commentaires toxiques qui explose en quelques minutes, sans événement déclencheur identifiable. Si votre taux de toxicité triple en 15 minutes sans que vous ayez rien publié de nouveau, c'est un signal fort.

Signal 2 — L'homogénéité des messages

Les commentaires utilisent les mêmes mots, les mêmes arguments, le même ton. Des variations existent mais le "brief" sous-jacent est visible. Des phrases entières sont copiées-collées ou très légèrement modifiées.

Signal 3 — Les comptes suspects

Analysez les profils des commentateurs :

- Comptes créés récemment (< 30 jours)

- Peu ou pas de contenu propre

- Pas d'historique d'interaction avec votre marque

- Photos de profil génériques ou volées

- Noms d'utilisateur aléatoires ou générés

Signal 4 — Le timing coordonné

Les commentaires arrivent en vagues synchronisées, souvent à des intervalles réguliers qui trahissent une coordination humaine ou automatisée. Une analyse temporelle révèle des clusters de publications.

Signal 5 — L'absence de spécificité

Les vrais clients citent des expériences spécifiques : dates, numéros de commande, détails de produit. Les trolls coordonnés restent génériques : "Votre marque est nulle", "Arnaque", "Boycott". Le grief est vague parce qu'il est inventé.

Signal 6 — La multi-plateforme simultanée

L'attaque se déploie simultanément sur plusieurs de vos canaux : Instagram, Facebook, TikTok, YouTube, Google Reviews. Cette coordination multi-plateforme est quasi impossible de manière organique.

Signal 7 — Les traces de coordination externe

Des fils de discussion sur Discord, Telegram, Reddit ou 4chan appellent explicitement à cibler votre marque, avec des instructions sur quoi commenter et où. Notre social monitoring permet parfois de détecter ces appels à l'action avant même que l'attaque ne soit lancée.

La matrice de diagnostic rapide

Utilisez cette matrice pour qualifier un événement en moins de 5 minutes :

Score : Si 4 critères ou plus pointent vers "attaque coordonnée", activez le protocole d'attaque. Ne perdez pas de temps — chaque minute compte.

Quels sont les différents types d'attaques coordonnées ?

Le raid communautaire

Origine : Une communauté en ligne (Discord gaming, forum idéologique, subreddit hostile) décide collectivement de cibler votre marque, souvent suite à une prise de position ou un partenariat controversé.

Caractéristiques :

- Volume élevé mais limité dans le temps (2-6 heures)

- Participants identifiables par leur appartenance communautaire

- Messages souvent thématiquement liés au grief communautaire

- Peut inclure des memes et du contenu visuel spécifique

Dangerosité : Moyenne à élevée. Le volume peut être massif mais l'attaque s'essouffle quand la communauté passe à autre chose.

Le review bombing

Origine : Une campagne coordonnée visant spécifiquement vos plateformes d'avis (Google, Trustpilot, App Store) avec des dizaines ou centaines de faux avis négatifs.

Caractéristiques :

- Concentration sur les plateformes d'avis

- Comptes créés spécifiquement pour l'opération

- Avis vagues, sans détails d'expérience spécifiques

- Impact direct et mesurable sur votre note moyenne

Dangerosité : Élevée. L'impact sur votre note est immédiat et les plateformes d'avis sont lentes à réagir. Le rétablissement peut prendre des semaines, comme nous l'analysons dans notre article sur l'impact des commentaires toxiques sur l'image de marque.

L'astroturfing concurrentiel

Origine : Un concurrent ou un acteur commercial commande une campagne de dénigrement via des fermes de comptes ou des agences peu scrupuleuses.

Caractéristiques :

- Attaque plus sophistiquée et plus difficile à détecter

- Les comptes peuvent avoir un historique plus crédible (comptes achetés)

- Les messages sont mieux rédigés et plus plausibles

- Objectif : créer une fausse perception de mécontentement généralisé

Dangerosité : Très élevée. La sophistication rend la détection plus difficile et l'impact sur la perception peut être durable si l'attaque n'est pas identifiée.

Le brigading idéologique

Origine : Des groupes idéologiques (politiques, activistes, mouvements sociaux) ciblent votre marque en raison d'une position réelle ou supposée.

Caractéristiques :

- Forte composante émotionnelle et idéologique

- Messages polarisants mêlant critiques politiques et attaques personnelles

- Implication possible de comptes influents dans l'espace idéologique

- Peut attirer une couverture médiatique

Dangerosité : Très élevée. La dimension idéologique rend la crise plus polarisante et plus durable. Toute réponse peut être instrumentalisée par l'un ou l'autre camp.

Le harcèlement ciblé coordonné

Origine : Un individu ou un petit groupe mobilise sa communauté pour cibler une personne spécifique associée à votre marque (employé, créateur partenaire, porte-parole).

Caractéristiques :

- Attaques personnelles ciblant un individu nommément

- Peut inclure du doxxing (publication d'informations personnelles)

- Impact psychologique direct et grave sur la personne ciblée

- Responsabilité légale potentielle pour la plateforme

Dangerosité : Critique. Au-delà de l'image de marque, la sécurité physique et psychologique d'une personne est en jeu. La réponse doit être immédiate et impliquer le juridique et potentiellement les autorités.

Comment réagir dans les premières minutes d'une attaque ?

Le protocole d'urgence en 4 étapes (0-30 minutes)

Étape 1 — Détection et diagnostic (0-5 min)

DIAGNOSTIC RAPIDE :

□ Le taux de toxicité a-t-il augmenté de > 200% en < 30 min ?

□ Les commentaires sont-ils homogènes (mêmes mots, même ton) ?

□ La majorité des comptes sont-ils suspects (récents, sans historique) ?

□ Y a-t-il un déclencheur identifiable (publication, actualité) ?

→ Si 3/4 premiers critères = OUI et dernier = NON :

ATTAQUE COORDONNÉE CONFIRMÉE → Étape 2

→ Si déclencheur identifiable :

Possible bad buzz organique → Vérifier avec matrice complète

Étape 2 — Activation du shield mode (5-10 min)

Activez immédiatement la modération renforcée sur Bodyguard.ai :

- Niveau de filtrage : Maximal

- Détection patterns coordonnés : Activée

- Protection harcèlement individuel : Renforcée

- Préservation critiques légitimes : Maintenue

L'objectif n'est pas de verrouiller l'espace — c'est de neutraliser l'attaque tout en protégeant les voix authentiques. La distinction est cruciale et c'est exactement ce que notre analyse contextuelle permet de faire.

Étape 3 — Alerte et mobilisation (10-15 min)

Alertez votre cellule de crise via le canal dédié :

ALERTE : Attaque coordonnée en cours

• Plateforme(s) : [Instagram / Facebook / TikTok / YouTube / Multi]

• Volume : [nombre] commentaires toxiques en [durée]

• Type probable : [raid / review bombing / astroturfing / brigading]

• Cible : [marque / employé spécifique / produit]

• Shield mode : ACTIVÉ

• Prochaine action : Documentation + évaluation communication

Étape 4 — Évaluation de la nécessité de communication (15-30 min)

La question clé : Faut-il communiquer publiquement sur l'attaque ?

Réponse : PRESQUE TOUJOURS NON.

Communiquer sur une attaque coordonnée est exactement ce que les attaquants espèrent. Cela :

- Leur donne de la visibilité et valide leur action

- Attire l'attention sur l'attaque auprès d'une audience qui ne l'avait pas vue

- Crée un narratif "marque en crise" alors qu'il s'agit d'une manipulation externe

- Fournit un nouveau sujet de discussion et prolonge l'attaque

Les seules exceptions :

- L'attaque est devenue médiatique (journalistes impliqués)

- Un employé est ciblé par du harcèlement grave nécessitant un soutien public

- L'attaque implique de la désinformation qui se propage au-delà des trolls

- L'ampleur est telle que votre communauté réelle pose des questions

Les premières minutes par type d'attaque

Raid communautaire :

- Shield mode maximal

- Pas de communication publique

- Laisser passer la vague (2-6h en général)

- Documenter silencieusement

Review bombing :

- Documenter chaque faux avis (screenshot + horodatage)

- Signaler en masse aux plateformes d'avis

- Ne pas répondre individuellement aux faux avis

- Préparer un dossier de contestation

Astroturfing concurrentiel :

- Shield mode

- Investigation approfondie (identifier la source)

- Documentation juridique dès le début

- Consultation juridique si preuves suffisantes

Brigading idéologique :

- Shield mode maximal

- Pas de prise de position supplémentaire

- Protéger les employés ciblés

- Attendre avant toute communication

Harcèlement ciblé :

- Shield mode immédiat sur tous les espaces

- Protection de la personne ciblée (passer comptes en privé)

- Alerte juridique + RH

- Si menaces : signalement aux autorités

Comment neutraliser l'attaque sans alimenter les attaquants ?

La règle d'or : ne jamais nourrir le troll

Le principe fondamental de la gestion d'une attaque coordonnée est contre-intuitif : la meilleure réponse est souvent l'absence de réponse visible. Chaque interaction publique avec les attaquants :

- Valide leur action : "On a réussi à les faire réagir"

- Fournit du matériel : Votre réponse sera screenshotée, déformée, moquée

- Prolonge l'engagement : L'algorithme détecte l'interaction et amplifie

- Déplace le sujet : La conversation passe de votre contenu à la "polémique"

Les trolls se nourrissent d'attention. Coupez l'alimentation.

La neutralisation silencieuse : votre arme la plus puissante

La stratégie optimale contre une attaque coordonnée est la neutralisation silencieuse — filtrer les attaquants sans que l'action soit visible :

Ce que voit l'attaquant : Son commentaire semble publié normalement. Il ne reçoit pas de notification de suppression. Il pense avoir réussi.

Ce que voit votre communauté : Un espace de conversation normal, avec les commentaires authentiques visibles. Les attaques ont disparu sans trace de "censure".

Ce que vous voyez : Le dashboard montre le volume d'attaque filtré, les patterns détectés, les comptes suspects identifiés. Vous avez les données sans les dégâts.

Notre technologie Bodyguard.ai permet exactement cette approche. Le shield mode masque les contenus toxiques coordonnés sans envoyer de signal aux attaquants, désamorçant l'attaque dans le silence.

Protéger les voix légitimes pendant l'attaque

Le piège le plus dangereux lors d'une attaque coordonnée : filtrer trop largement et bloquer des vrais clients dans le processus.

Le risque : Un vrai client mécontent poste pendant l'attaque. Son commentaire est filtré avec ceux des trolls. Il capture l'écran, poste "Ils censurent même les vrais clients !" et transforme votre défense en accusation de censure.

La protection : Notre analyse contextuelle distingue les vrais clients des comptes coordonnés en analysant :

- L'historique du compte (ancienneté, interactions passées)

- La spécificité du message (expérience concrète vs griefs génériques)

- Le pattern comportemental (commentaire isolé vs vague synchronisée)

- Le langage (vocabulaire client vs vocabulaire de brief d'attaque)

Cette distinction est impossible avec une modération par mots-clés qui traiterait tous les commentaires négatifs de la même manière. Seule l'analyse contextuelle peut protéger les voix légitimes tout en neutralisant l'attaque.

Gérer le cas où l'attaque devient visible

Si malgré votre neutralisation, l'attaque gagne en visibilité (couverture médiatique, relai par des influenceurs), adaptez votre approche :

Communication factuelle et mesurée :

"Nous avons détecté une activité inauthentique coordonnée sur nos espaces. Des centaines de comptes récemment créés ont publié des messages similaires dans un laps de temps très court.

Nous avons pris les mesures nécessaires pour protéger notre communauté et nous avons signalé ces comportements aux plateformes concernées.

Nos espaces restent ouverts à tous les échanges authentiques — critiques incluses. Nous invitons nos clients à continuer de s'exprimer librement.

— [Prénom, fonction]"

Ce que ce message fait :

- Nomme l'attaque pour ce qu'elle est : inauthentique et coordonnée

- Fournit des preuves implicites (comptes récents, messages similaires)

- Rassure la communauté sur la protection de l'espace

- Réaffirme l'ouverture aux critiques légitimes

Ce que ce message ne fait pas :

- Accuser un groupe spécifique sans preuve formelle

- Détailler les mécanismes de défense (information utile aux attaquants)

- Donner de la visibilité aux attaquants en les nommant

- Minimiser ou dramatiser

Consultez notre plan de communication de crise pour les templates complets adaptables à ce scénario.

Comment documenter et signaler une attaque coordonnée ?

Pourquoi la documentation est critique

Documenter méticuleusement une attaque coordonnée sert trois objectifs :

Le signalement aux plateformes : Les plateformes (Meta, Google, TikTok, YouTube) ont des processus de signalement des comportements coordonnés inauthentiques. Un dossier bien documenté accélère considérablement leur traitement.

Le recours juridique potentiel : En cas d'astroturfing concurrentiel, de diffamation coordonnée ou de harcèlement grave, votre documentation devient une pièce maîtresse du dossier juridique.

L'apprentissage interne : Chaque attaque documentée enrichit votre compréhension des menaces et renforce vos défenses futures.

Le protocole de documentation

DOSSIER D'ATTAQUE COORDONNÉE

1. VUE D'ENSEMBLE

• Date et heure de début de l'attaque

• Durée totale

• Plateforme(s) ciblée(s)

• Volume total de commentaires/avis toxiques

• Type d'attaque identifié

2. PREUVES DE COORDINATION

• Screenshots horodatés des commentaires (avec URL)

• Analyse des comptes : date de création, historique,

photo de profil

• Analyse de similarité des messages (pourcentage de

contenu identique)

• Timeline montrant les clusters de publication

• Captures de coordination externe si trouvées

(Discord, Telegram, forum)

3. IMPACT

• Évolution du taux de toxicité (avant, pendant, après)

• Impact sur les métriques (engagement, sentiment,

note avis)

• Commentaires légitimes impactés

• Employés ciblés et nature du harcèlement

4. ACTIONS PRISES

• Heure d'activation du shield mode

• Nombre de commentaires filtrés

• Signalements aux plateformes (dates, numéros de ticket)

• Communication publique (si applicable)

• Actions juridiques (si applicable)

5. PREUVES TECHNIQUES (Bodyguard.ai)

• Export des données de toxicité avec timestamps

• Rapport de détection de patterns coordonnés

• Liste des comptes identifiés comme suspects

• Logs de modération

Le signalement aux plateformes

Chaque plateforme a ses propres processus. Voici les points clés :

Meta (Facebook/Instagram) :

- Outil de signalement "Comportement inauthentique coordonné"

- Joindre le dossier avec preuves de coordination

- Demander la révision en masse des comptes suspects

- Temps de réponse moyen : 3-7 jours

Google (Reviews) :

- Signalement via Google Business Profile

- Signaler chaque faux avis individuellement + demande de révision groupée

- Fournir les preuves de patterns (dates, comptes, similarité)

- Temps de réponse moyen : 7-14 jours (souvent plus long)

TikTok :

- Outil de signalement in-app + formulaire dédié pour les marques

- Signaler comme "spam/comportement inauthentique"

- Temps de réponse moyen : 2-5 jours

YouTube :

- Signalement via YouTube Studio

- Option "Spam ou abus" avec description détaillée

- Temps de réponse moyen : 3-10 jours

Trustpilot :

- Outil de signalement de faux avis avec preuves

- Processus de vérification relativement rigoureux

- Temps de réponse moyen : 5-14 jours

Quand impliquer le juridique

Consultez votre service juridique si :

- L'attaque contient de la diffamation caractérisée

- Vous identifiez la source (concurrent, individu, organisation)

- Des données personnelles d'employés sont publiées (doxxing)

- Des menaces physiques sont proférées

- L'attaque cause un préjudice commercial documentable

- L'astroturfing concurrentiel est prouvable

Le dossier de documentation que vous avez constitué sera la base de toute action juridique. Plus il est complet et horodaté, plus vos chances de recours sont élevées.

Comment renforcer vos défenses pour prévenir les prochaines attaques ?

L'analyse post-attaque

Après chaque attaque, menez une analyse approfondie :

Questions clés :

- Comment l'attaque a-t-elle été détectée ? Pouvions-nous la détecter plus tôt ?

- Le shield mode a-t-il été activé assez rapidement ?

- Des voix légitimes ont-elles été impactées par le filtrage ?

- L'attaque venait-elle d'un vecteur que nous ne surveillions pas ?

- Les attaquants ont-ils exploité une vulnérabilité spécifique ?

Métriques à analyser :

Le renforcement progressif des défenses

Niveau 1 — Protection de base :

- Modération IA active en permanence sur tous les espaces

- Alertes configurées pour les pics de toxicité anormaux

- Shield mode préconfiguré et activable en un clic

- Protocole d'urgence documenté et accessible

Niveau 2 — Protection avancée :

- Détection de patterns coordonnés activée

- Surveillance des espaces externes (Discord, Telegram, Reddit) où les attaques se planifient

- Analyse comportementale des comptes pour identifier les profils suspects

- Exercices de simulation d'attaque trimestriels

Niveau 3 — Protection proactive :

- Veille active sur les communautés hostiles identifiées

- Analyse prédictive des risques d'attaque (avant lancement, prise de position, partenariat)

- Réseau de contacts dans les équipes "Trust & Safety" des plateformes

- Stratégie juridique préventive documentée

Notre article sur les alertes et signaux faibles détaille comment anticiper les attaques avant même qu'elles ne soient lancées.

La construction d'une communauté résiliente

Votre meilleure défense à long terme n'est pas technologique — elle est communautaire :

Des espaces de conversation protégés au quotidien : Une communauté habituée à un espace sain et bien modéré est plus résiliente face aux attaques. Les membres reconnaissent les trolls et ne les nourrissent pas. Notre modération proactive maintient cette santé communautaire en continu.

Des ambassadeurs identifiés et cultivés : Vos membres les plus fidèles et les plus engagés sont vos premiers défenseurs. En cas d'attaque, ils relativisent, ils contextualisent, ils soutiennent. Investissez dans cette relation avant d'en avoir besoin.

Une transparence établie : Une marque connue pour sa transparence bénéficie d'un capital de confiance qui amortit les attaques. Quand votre communauté vous fait confiance, les accusations infondées des trolls tombent à plat.

Une culture du dialogue : Les communautés où les critiques sont écoutées et traitées sont moins vulnérables à l'instrumentalisation. Si vos clients savent que vous gérez les commentaires négatifs avec sérieux, ils sont moins susceptibles de croire les narratifs toxiques des attaquants.

Conclusion

Les attaques coordonnées de trolls sont devenues une réalité du paysage digital en 2026. Qu'il s'agisse de raids communautaires, de review bombing, d'astroturfing concurrentiel ou de brigading idéologique, ces attaques partagent un objectif commun : détruire votre espace de conversation et nuire à votre image.

La réponse efficace repose sur trois piliers. La détection rapide — identifier l'attaque dans les premières minutes grâce aux signaux caractéristiques (vélocité anormale, messages homogènes, comptes suspects). La neutralisation silencieuse — filtrer les attaquants sans leur donner la visibilité qu'ils recherchent, grâce au shield mode et à l'analyse contextuelle. Et la documentation rigoureuse — constituer un dossier qui permettra le signalement aux plateformes et, si nécessaire, le recours juridique.

La règle d'or reste inchangée : ne jamais nourrir le troll. Chaque réponse publique aux attaquants est une victoire pour eux et un risque pour vous. La neutralisation silencieuse, rendue possible par notre technologie Bodyguard.ai, est l'approche qui produit les meilleurs résultats : l'attaque est désamorcée, vos vrais clients sont protégés et les attaquants se découragent face à un espace qui semble imperméable à leurs efforts.

Mais la meilleure défense est une communauté forte, des espaces bien modérés au quotidien et une culture de transparence qui rend les narratifs toxiques inaudibles. Investissez dans cette résilience avant la prochaine attaque — car dans le paysage digital actuel, la question n'est pas de savoir si elle arrivera, mais quand.

Pour intégrer ces protocoles dans votre stratégie globale de gestion de crise, consultez notre guide complet. Si vous souhaitez voir comment notre technologie détecte et neutralise les attaques coordonnées en temps réel, [demandez une démonstration personnalisée].

*Cet article fait partie de notre série sur la gestion de crise. Découvrez également nos guides sur le plan de communication de crise, les 10 erreurs qui aggravent tout, reprendre le contrôle d'un post qui dégénère, les alertes et signaux faibles. Explorez aussi notre expertise en e-réputation et modération de contenu.

© 2025 Bodyguard.ai — Tous droits réservés.