Keyword-based moderation : pourquoi ça ne marche plus en 2026

Pendant des années, la modération par mots-clés a été le pilier de la sécurité en ligne. Le principe était simple : créer une liste noire de termes interdits, et tout contenu contenant ces mots était automatiquement bloqué ou signalé. Simple, rapide, peu coûteux. En 2026, cette approche est non seulement obsolète, elle est dangereuse.

Dangereuse parce qu'elle donne une illusion de protection. Dangereuse parce qu'elle censure des discussions légitimes tout en laissant passer les formes de toxicité les plus sophistiquées. Dangereuse parce qu'elle pousse les utilisateurs malveillants à développer des stratégies de contournement toujours plus créatives, créant une course aux armements que la keyword-based moderation ne peut pas gagner.

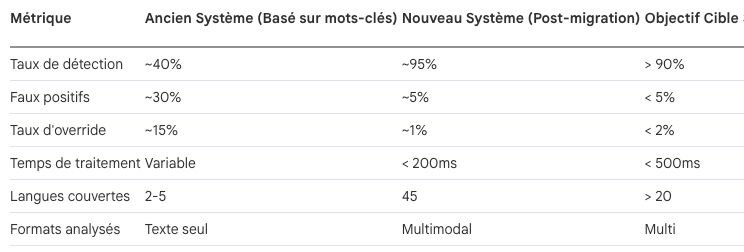

Chez Bodyguard.ai, nous avons observé cette évolution de près. Notre technologie d'analyse contextuelle a été conçue précisément pour dépasser les limites des filtres par mots-clés, avec un taux de détection de 95% contre moins de 40% pour les systèmes basés uniquement sur des listes de termes. Dans cet article, nous expliquons pourquoi la modération par mots-clés ne fonctionne plus, et quelles solutions adopter pour une protection réellement efficace en 2026. Pour une vision complète, consultez notre guide sur la modération de contenu.

Sommaire

Qu'est-ce que la keyword-based moderation ?Pourquoi la modération par mots-clés a-t-elle longtemps été la norme ?Quelles sont les limites critiques de la modération par mots-clés en 2026 ?Comment les utilisateurs contournent-ils les filtres par mots-clés ?Quelles alternatives à la keyword-based moderation en 2026 ?Comment réussir la transition vers une modération intelligente ?Qu'est-ce que la keyword-based moderation ?

Le principe fondamental

La keyword-based moderation, ou modération par mots-clés, repose sur un mécanisme simple : un système scanne chaque contenu publié à la recherche de termes figurant dans une liste prédéfinie. Si un mot ou une expression correspond à la liste noire, le contenu est automatiquement bloqué, masqué ou signalé pour révision humaine.

Ce système fonctionne comme un filet de pêche à mailles fixes : il attrape tout ce qui correspond à une taille donnée, mais laisse passer tout le reste, quelle que soit sa nature réelle.

Les différentes formes de filtrage par mots-clés

Les listes noires (blacklists) : Des catalogues de mots interdits qui déclenchent automatiquement une action de modération. Ces listes peuvent contenir des centaines, voire des milliers de termes.

Les listes blanches (whitelists) : Des exceptions autorisées pour éviter de bloquer certains usages légitimes de mots figurant dans la liste noire.

Les expressions régulières (regex) : Des patterns plus sophistiqués qui permettent de détecter des variations de mots (pluriels, conjugaisons, fautes intentionnelles).

Les filtres combinés : Des systèmes qui associent plusieurs mots-clés pour tenter de capturer le contexte, par exemple "tu es" + [insulte].

Comment la keyword-based moderation a dominé le marché

Pendant plus d'une décennie, cette approche a été le standard de l'industrie pour plusieurs raisons compréhensibles :

- Facilité d'implémentation : Quelques heures suffisent pour mettre en place un filtre par mots-clés basique

- Coût minimal : Pas besoin d'IA complexe ou de ressources computationnelles importantes

- Transparence apparente : Les règles sont explicites et faciles à comprendre

- Contrôle direct : Les équipes de modération peuvent ajouter ou retirer des termes instantanément

Mais ce qui fonctionnait dans un internet plus simple ne résiste pas à la complexité du web en 2026.

Pourquoi la modération par mots-clés a-t-elle longtemps été la norme ?

Un internet plus simple et moins massif

Dans les premières années des réseaux sociaux, les interactions étaient principalement textuelles, les communautés plus petites et les formes de toxicité plus directes. Un utilisateur qui voulait insulter quelqu'un utilisait des termes explicites, facilement détectables par un filtre par mots-clés.

Le volume de contenu était également gérable. Les équipes de modération pouvaient compléter les filtres automatiques par une revue humaine efficace, rattrapant les erreurs du système.

Des ressources technologiques limitées

Les technologies de traitement du langage naturel (NLP) et d'intelligence artificielle n'étaient pas suffisamment matures pour offrir une alternative viable. La keyword-based moderation était la solution la plus avancée techniquement accessible à la plupart des plateformes.

Une toxicité moins sophistiquée

Les utilisateurs malveillants n'avaient pas encore développé les stratégies de contournement élaborées que nous observons aujourd'hui. L'écart entre la capacité de détection des filtres et la créativité des contournements était encore gérable.

Un cadre réglementaire moins exigeant

Les obligations légales en matière de modération étaient moins strictes. Le Digital Services Act, les réglementations sur la protection des mineurs et les exigences de transparence n'existaient pas encore, permettant une approche plus basique de la modération.

Quelles sont les limites critiques de la modération par mots-clés en 2026 ?

Le fléau des faux positifs

C'est la limite la plus visible et la plus frustrante. Un système de keyword-based moderation bloque aveuglément tout contenu contenant un terme interdit, sans aucune compréhension du contexte. Les conséquences sont désastreuses :

Censure de discussions légitimes : Un article éducatif sur le racisme est bloqué parce qu'il contient le mot "racisme". Une discussion médicale sur le suicide est supprimée parce qu'elle mentionne le terme. Un débat sur les violences policières est censuré parce qu'il utilise le mot "violence".

Frustration des utilisateurs : Les faux positifs répétés poussent les utilisateurs légitimes à quitter la plateforme ou à perdre confiance dans le système de modération. Cette érosion de confiance est particulièrement dommageable pour votre e-réputation.

Surcharge des modérateurs humains : Chaque faux positif génère une file d'attente pour révision manuelle, noyant les modérateurs sous des cas non pertinents et les empêchant de se concentrer sur les vrais cas de toxicité.

Nos données montrent que les systèmes basés uniquement sur des mots-clés génèrent jusqu'à 30% de faux positifs, contre moins de 5% pour notre approche contextuelle.

L'angle mort des faux négatifs

Plus dangereux encore que les faux positifs : ce que la keyword-based moderation ne détecte pas. Les formes de toxicité les plus nocives en 2026 sont précisément celles qui évitent les mots-clés explicites :

Le harcèlement subtil : "Tu devrais vraiment arrêter d'essayer" ou "Tout le monde pense pareil mais personne n'ose te le dire" sont des messages profondément toxiques qui ne contiennent aucun mot interdit.

La manipulation émotionnelle : Le gaslighting, l'isolement social et la dévalorisation systématique utilisent un vocabulaire parfaitement neutre.

Les menaces voilées : "Je sais où tu habites, fais attention en rentrant" est une menace claire qui ne contient aucun mot-clé de violence.

La toxicité par accumulation : Des messages individuellement innocents qui, combinés, constituent du harcèlement coordonné. Notre fonctionnalité d'analyse de groupes de messages est conçue précisément pour détecter ces patterns, comme nous l'expliquons dans notre article sur l'analyse contextuelle en modération.

L'impossibilité de comprendre le contexte

Le même mot peut être toxique ou parfaitement légitime selon le contexte. La keyword-based moderation est structurellement incapable de faire cette distinction :

- "Tu me tues" → Expression affectueuse entre amis vs menace réelle

- "C'est de la bombe" → Compliment enthousiaste vs référence à un explosif

- "Sale temps" → Météo vs insulte selon le contexte

- "Je vais te détruire" → Compétition gaming vs menace personnelle

Cette incapacité fondamentale à comprendre le contexte rend la keyword-based moderation inadaptée à la complexité des interactions humaines en ligne, un sujet que nous approfondissons dans notre article dédié à la compréhension du contexte en modération.

L'inadaptation au contenu multilingue

Les filtres par mots-clés fonctionnent langue par langue, nécessitant des listes séparées pour chaque idiome. Mais la réalité du web en 2026 est multilingue : les utilisateurs mélangent les langues, utilisent des translittérations et inventent des néologismes cross-linguistiques.

Un filtre par mots-clés ne peut pas gérer le code-switching (alternance de langues dans un même message), les translittérations arabes en caractères latins (Arabizi), ou les emprunts créatifs entre langues. Notre article sur la modération multilingue détaille ces défis en profondeur.

L'inadaptation aux formats non-textuels

En 2026, la majorité du contenu en ligne est visuel ou audiovisuel : vidéos TikTok, reels Instagram, stories, lives, memes. La keyword-based moderation est structurellement limitée au texte et ne peut pas analyser :

- Le texte incrusté dans les images

- Les symboles et emojis utilisés de manière toxique

- Le contenu audio des vidéos et lives

- Les memes dont la toxicité réside dans la combinaison image/texte

Cette limitation est critique à l'ère où les plateformes visuelles dominent, comme nous l'expliquons dans notre guide sur la modération de Facebook, Instagram, TikTok et YouTube.

Solution de modération qui comprend le contexte

Comment les utilisateurs contournent-ils les filtres par mots-clés ?

Substitution de caractères et leetspeak

La technique la plus basique mais toujours efficace consiste à remplacer des lettres par des caractères similaires :

- Lettres par chiffres : a→4, e→3, i→1, o→0

- Lettres par symboles : s→$, a→@, i→!

- Caractères Unicode similaires : utilisation de lettres cyrilliques ou grecques visuellement identiques aux latines

- Espaces et ponctuation insérés : "h.a.i.n.e" ou "h a i n e"

Ces substitutions sont quasi infinies et créent une course aux armements impossible à gagner pour les listes de mots-clés.

Fragmentation et contournement syntaxique

Les utilisateurs sophistiqués fragmentent leurs messages toxiques en plusieurs parties apparemment innocentes :

- Message 1 : "Toi..."

- Message 2 : "tu mérites vraiment..."

- Message 3 : "ce qui va t'arriver"

Pris individuellement, aucun de ces messages ne contient de mot-clé toxique. Ensemble, ils constituent une menace claire. Seule une analyse contextuelle de groupes de messages peut détecter ce type de harcèlement.

Utilisation de codes et dog whistles

Les communautés toxiques développent constamment de nouveaux codes compris uniquement par leurs membres :

- Références numériques à des idéologies extrémistes

- Emojis utilisés comme codes (certaines combinaisons d'emojis véhiculent des messages haineux)

- Termes apparemment innocents détournés de leur sens original

- Memes et références culturelles codées

Ces codes évoluent dès qu'ils sont identifiés, rendant les listes de mots-clés perpétuellement obsolètes. Notre approche de social listening permet de détecter ces nouveaux codes dès leur émergence.

Translittérations et mélanges linguistiques

Les utilisateurs exploitent les limites linguistiques des filtres :

- Écrire des insultes arabes en caractères latins (Arabizi)

- Mélanger plusieurs langues dans un même message

- Utiliser des dialectes ou argots non répertoriés

- Inventer des néologismes toxiques

Ces techniques rendent la keyword-based moderation multilingue pratiquement impossible à maintenir efficacement, un défi que nous détaillons dans notre article sur la modération multilingue.

Toxicité implicite et manipulation psychologique

La forme de contournement la plus sophistiquée et la plus dangereuse : exprimer de la toxicité sans utiliser aucun mot négatif.

- "Tout le monde serait mieux sans toi" → Incitation au suicide sans terme explicite

- "Intéressant comme tu es toujours la seule à penser ça" → Isolement social

- "Je te souhaite exactement ce que tu mérites" → Menace implicite

- Séries de questions rhétoriques déstabilisantes → Harcèlement moral

Ces formes de toxicité implicite sont les plus nocives psychologiquement et les plus invisibles pour les filtres par mots-clés. Elles nécessitent une compréhension profonde de l'intention et du contexte que seule une modération IA avancée peut fournir.

Quelles alternatives à la keyword-based moderation en 2026 ?

L'analyse contextuelle par intelligence artificielle

L'alternative la plus puissante à la keyword-based moderation est l'analyse contextuelle par IA. Au lieu de chercher des mots isolés, cette approche analyse :

- L'intention derrière le message : Que cherche l'auteur à accomplir ?

- Le ton : Sarcastique, menaçant, affectueux, agressif ?

- Le contexte conversationnel : Que s'est-il dit avant et après ?

- Les patterns comportementaux : L'auteur a-t-il un historique de toxicité ?

Notre technologie chez Bodyguard.ai utilise cette approche pour atteindre un taux de détection de 95% avec moins de 5% de faux positifs, une performance impossible avec des mots-clés seuls. Pour comprendre en détail comment fonctionne cette analyse, consultez notre article sur la compréhension du contexte en modération

L'analyse multimodale

En 2026, la modération doit aller au-delà du texte. L'analyse multimodale combine :

- Analyse textuelle : Compréhension sémantique et contextuelle des messages

- Analyse visuelle : Détection de contenu inapproprié dans les images et vidéos

- Analyse audio : Transcription et analyse du contenu verbal dans les lives et vidéos

- Analyse comportementale : Identification des patterns de publication suspects

Cette approche globale est essentielle pour modérer efficacement Facebook, Instagram, TikTok et YouTube, où chaque plateforme combine différents formats de contenu.

L'approche hybride humain-IA

La technologie seule ne suffit pas. L'approche la plus efficace en 2026 combine trois couches complémentaires :

Couche 1 — IA contextuelle : Détection automatique de 90% des contenus toxiques en temps réel, quelle que soit la forme ou la langue utilisée.

Couche 2 — Expertise linguistique : Des linguistes spécialisés enrichissent continuellement les modèles avec les évolutions culturelles et linguistiques de chaque région. Cette expertise est cruciale pour la modération multilingue.

Couche 3 — Modération humaine : Des modérateurs formés traitent les cas complexes et ambigus, apportant le jugement nuancé que l'IA ne peut pas encore reproduire. Notre article sur la modération automatique vs humaine détaille cet équilibre.

Le social listening proactif

Plutôt que d'attendre passivement que la toxicité se manifeste, les solutions modernes surveillent activement les tendances émergentes :

- Détection de nouveaux codes et dog whistles dès leur apparition

- Surveillance des mouvements de harcèlement coordonné

- Identification des sujets sensibles avant qu'ils ne dégénèrent

- Anticipation des crises potentielles

Cette approche proactive, au cœur du social listening moderne, transforme la modération d'une posture défensive en une stratégie d'anticipation.

La personnalisation par plateforme et communauté

Contrairement à l'approche one-size-fits-all de la keyword-based moderation, les solutions modernes s'adaptent au contexte spécifique de chaque communauté :

- Seuils de toxicité ajustables par plateforme, canal et audience

- Règles de modération personnalisées selon la culture communautaire

- Profils de modération évolutifs qui s'adaptent aux changements de comportement

- Paramétrage fin par les équipes de modération via des interfaces intuitives

Solution de modération IA Bodyguard

Comment réussir la transition vers une modération intelligente ?

Auditer votre système actuel

Avant de migrer, évaluez honnêtement les performances de votre keyword-based moderation actuelle :

Mesurez vos taux de faux positifs : Combien de contenus légitimes sont bloqués à tort ? Analysez un échantillon significatif de contenus modérés pour établir un baseline réaliste.

Estimez vos faux négatifs : C'est plus difficile mais crucial. Combien de contenus toxiques passent à travers vos filtres ? Des audits manuels réguliers permettent d'estimer cet angle mort.

Évaluez le coût total : Additionnez le temps passé à maintenir les listes de mots-clés, à traiter les faux positifs, à gérer les plaintes d'utilisateurs censurés à tort, et les dommages causés par la toxicité non détectée.

Identifiez les lacunes critiques : Quelles langues, plateformes et formats ne sont pas couverts par votre système actuel ?

Planifier une migration progressive

La transition vers une modération intelligente ne se fait pas du jour au lendemain. Nous recommandons une approche en trois phases :

Phase 1 — Mode parallèle (1-2 mois) : Déployez la solution IA en parallèle de vos filtres existants. Comparez les résultats sans impact sur votre modération en cours. Cette phase permet de calibrer la solution et de mesurer les gains.

Phase 2 — Transition hybride (2-3 mois) : Activez progressivement la modération IA sur des segments spécifiques (une plateforme, une langue, un type de contenu). Maintenez les mots-clés en filet de sécurité tout en augmentant la part de l'IA.

Phase 3 — Migration complète (1-2 mois) : Basculez entièrement vers la modération intelligente. Les listes de mots-clés deviennent un complément optionnel plutôt que le système principal.

Mesurer les résultats et optimiser

Après la migration, suivez des KPIs clairs pour valider les gains :

Conclusion

La keyword-based moderation a rendu des services précieux à une époque où internet était plus simple, les interactions plus directes et les formes de toxicité plus explicites. Cette époque est révolue.

En 2026, les utilisateurs malveillants sont plus créatifs que jamais. Ils fragmentent leurs messages, utilisent des codes culturels, mélangent les langues, exploitent les formats visuels et pratiquent une toxicité implicite que aucun filtre par mots-clés ne peut détecter. Continuer à s'appuyer uniquement sur des listes noires, c'est protéger sa communauté avec un bouclier percé de milliers de trous.

L'alternative existe. L'analyse contextuelle par IA, combinée à l'expertise linguistique humaine et à une approche multimodale, offre une protection véritablement efficace. Avec un taux de détection de 95%, moins de 5% de faux positifs et une couverture de 45 langues, les solutions modernes comme Bodyguard.ai rendent la keyword-based moderation obsolète, pas par principe, mais par les résultats.

La transition n'est pas un luxe, c'est une nécessité. Les plateformes qui persistent avec une approche par mots-clés s'exposent à des risques réglementaires croissants, une dégradation de leur communauté et une e-réputation fragilisée. Celles qui investissent dans une modération intelligente protègent non seulement leurs utilisateurs, mais construisent un avantage compétitif durable.

Pour approfondir votre compréhension des solutions modernes de modération, explorez notre guide complet sur la modération de contenu. Si vous êtes prêt à dépasser les limites de la keyword-based moderation, [demandez une démonstration personnalisée] et découvrez ce que l'analyse contextuelle peut faire pour votre communauté.

*Cet article fait partie de notre série sur la modération de contenu. Découvrez également nos articles sur la modération IA et ses avantages, la compréhension du contexte en modération et la modération multilingue.

Explorez aussi nos ressources sur la sécurité en ligne et la gestion de crise pour une stratégie de protection complète.*

Vous voulez découvrir Bodyguard ?

Demander une démo

© 2025 Bodyguard.ai — Tous droits réservés.